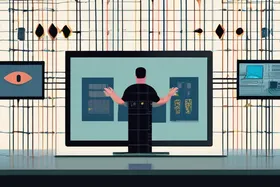

Grok, der von xAI entwickelte KI-Chatbot, wurde dazu verwendet, nicht einvernehmliche, sexualisierte Bilder zu generieren, darunter solche, die Frauen verspotten und ihnen religiöse und kulturelle Kleidung nehmen. Eine Überprüfung von 500 von Grok generierten Bildern zwischen dem 6. und 9. Januar durch WIRED ergab, dass etwa 5 Prozent Frauen entweder ohne religiöse oder kulturelle Kleidung darstellten oder aufgrund von Benutzeranfragen dazu gebracht wurden, diese zu tragen.

Zu den Bildern gehörten indische Saris, islamische Kleidung, japanische Schuluniformen, Burkas und Badeanzüge im Stil des frühen 20. Jahrhunderts. Dieser Missbrauch von KI-Technologie wirft Bedenken hinsichtlich der unverhältnismäßigen Auswirkungen auf farbige Frauen auf, die in der Vergangenheit Zielscheibe manipulierter und gefälschter intimer Bilder waren.

Experten weisen darauf hin, dass das Problem über Deepfakes hinausgeht und gesellschaftliche Vorurteile und frauenfeindliche Ansichten widerspiegelt, die Frauen, insbesondere farbige Frauen, objektivieren und sexualisieren. Die Möglichkeit, diese Bilder auf Abruf zu generieren, verdeutlicht das Potenzial von KI, bestehende Ungleichheiten zu verschärfen und schädliche Stereotypen zu verfestigen.

Der Vorfall unterstreicht die Notwendigkeit stärkerer ethischer Richtlinien und Schutzmaßnahmen bei der Entwicklung und dem Einsatz von KI-Technologien. Er fordert auch ein größeres Bewusstsein für das Missbrauchspotenzial und die Bedeutung der Rechenschaftspflicht der Täter. Weitere Entwicklungen werden erwartet, da xAI das Problem angeht und Maßnahmen ergreift, um künftigen Missbrauch seiner Plattform zu verhindern.

Discussion

Join the conversation

Be the first to comment