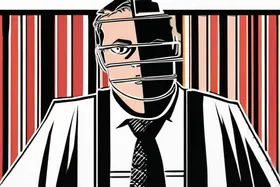

Imágenes generadas por IA que representan el arresto de Nicolás Maduro inundaron las redes sociales. Las fotos falsas se difundieron rápidamente el sábado, mostrando al presidente venezolano esposado y bajo custodia militar. Los expertos creen que las herramientas de IA crearon las imágenes. Esto marca un nuevo y preocupante desarrollo en el potencial de la IA para la desinformación.

Las imágenes surgieron horas después de informes falsos del arresto de Maduro por fuerzas estadounidenses. A pesar de las salvaguardias de los principales generadores de imágenes de IA contra contenido engañoso e imágenes falsas de figuras públicas, las herramientas produjeron las imágenes. La herramienta de IA específica utilizada sigue sin identificarse.

El incidente destaca el desafío de controlar la desinformación generada por la IA. Roberta Braga, del Digital Democracy Institute of the Americas, señaló esto como una primera instancia de imágenes generalizadas de IA que representan un supuesto evento en tiempo real. La rápida propagación plantea interrogantes sobre el impacto en la percepción pública y la confianza.

Los generadores de imágenes de IA emplean algoritmos para crear imágenes realistas a partir de indicaciones de texto. Si bien muchos tienen políticas contra el uso indebido, eludir estas salvaguardias resulta posible. Este incidente subraya la necesidad de mejorar la detección y regulación de la desinformación generada por la IA.

Se espera un mayor escrutinio de las plataformas de generación de imágenes de IA. Es probable que se investigue más a fondo la fuente y la difusión de las imágenes. El incidente alimentará el debate sobre las directrices éticas y las soluciones tecnológicas para combatir la desinformación impulsada por la IA.

Discussion

Join the conversation

Be the first to comment