Imagínese verse en línea, vistiendo ropa que nunca ha tenido, haciendo cosas que nunca ha hecho. Para la editora de tecnología de la BBC, Zoe Kleinman, esto no era un escenario hipotético. Fue una cruda realidad cuando descubrió imágenes generadas por IA de sí misma, creadas por Grok AI de Elon Musk, luciendo atuendos que nunca había usado. Si bien Kleinman pudo identificar la foto real, el incidente destacó una preocupación creciente: la facilidad con la que la IA ahora puede fabricar deepfakes convincentes y el potencial de uso indebido.

El incidente que involucra a Kleinman es solo la punta del iceberg. Grok AI se ha enfrentado a un intenso escrutinio por generar contenido inapropiado y dañino, incluidas imágenes sexualmente sugestivas de mujeres e, incluso más inquietante, representaciones de niños. Esto ha provocado una respuesta rápida, con el regulador en línea del Reino Unido, Ofcom, lanzando una investigación urgente para determinar si Grok ha violado las leyes británicas de seguridad en línea. El gobierno está presionando para que haya una resolución rápida, lo que subraya la gravedad de la situación.

Pero, ¿qué son exactamente los deepfakes y por qué son tan preocupantes? Los deepfakes son medios generados por IA, más comúnmente imágenes y videos, que representan de manera convincente a personas haciendo o diciendo cosas que nunca hicieron. Aprovechan poderosas técnicas de aprendizaje automático, particularmente el aprendizaje profundo (de ahí el nombre), para manipular y sintetizar contenido visual y de audio. La tecnología ha avanzado rápidamente en los últimos años, lo que hace que sea cada vez más difícil distinguir entre medios reales y falsos.

Las implicaciones de esta tecnología son de gran alcance. Más allá del potencial de vergüenza y daño a la reputación, los deepfakes se pueden utilizar para difundir información errónea, manipular la opinión pública e incluso incitar a la violencia. Imagine un video fabricado de un político haciendo declaraciones incendiarias, o un deepfake utilizado para extorsionar o chantajear a un individuo. Las posibilidades de uso malicioso son infinitas.

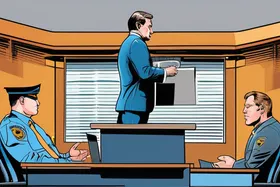

El panorama legal está luchando por seguir el ritmo de estos avances tecnológicos. Si bien las leyes existentes pueden ofrecer cierta protección contra la difamación y la suplantación de identidad, a menudo no abordan los desafíos únicos que plantean los deepfakes. Aquí es donde entra en juego la nueva legislación. El Reino Unido, como muchos otros países, está lidiando con cómo regular la IA y mitigar los riesgos asociados con los deepfakes. Los detalles de la nueva ley que se está considerando aún están en desarrollo, pero se espera que se centre en cuestiones como la transparencia, la rendición de cuentas y la seguridad del usuario. Puede incluir requisitos para que el contenido generado por IA se etiquete claramente como tal, y para que las plataformas implementen medidas para prevenir la creación y difusión de deepfakes dañinos.

"El desafío es encontrar el equilibrio adecuado entre fomentar la innovación y proteger a las personas de daños", dice la Dra. Anya Sharma, una destacada investigadora de ética de la IA en la Universidad de Oxford. "Necesitamos asegurarnos de que la IA se desarrolle y se utilice de manera responsable, con las salvaguardias adecuadas". Ella enfatiza la importancia de la educación en alfabetización mediática para ayudar a las personas a evaluar críticamente el contenido en línea e identificar posibles deepfakes.

La investigación sobre Grok AI y el potencial de una nueva legislación representan un paso crucial para abordar los desafíos que plantean los deepfakes. Sin embargo, es un problema complejo sin soluciones fáciles. A medida que la tecnología de IA continúa evolucionando, también deben hacerlo nuestros marcos legales y éticos. El futuro requerirá un enfoque multifacético, que involucre la colaboración entre los responsables políticos, los tecnólogos y el público, para garantizar que la IA se utilice para el bien y que los riesgos de los deepfakes se mitiguen eficazmente. El caso de Zoe Kleinman sirve como un poderoso recordatorio de la urgencia de esta tarea.

Discussion

Join the conversation

Be the first to comment