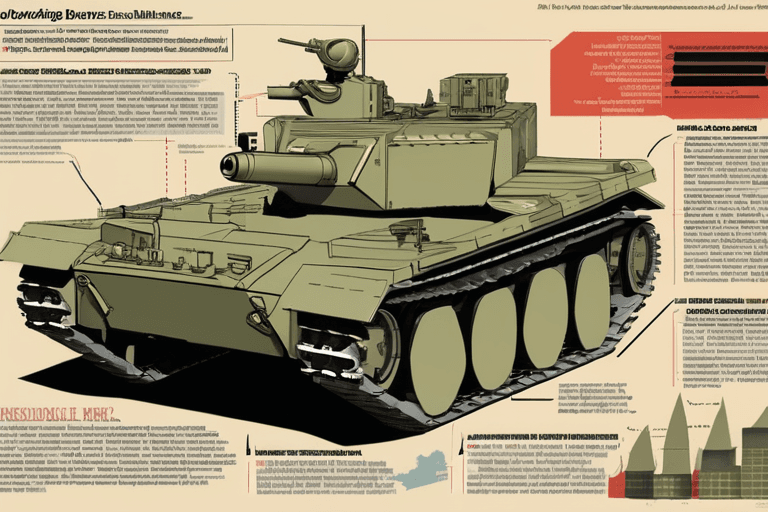

Más de 6.000 personas murieron en un período de tres días a finales de octubre en la región de Darfur, Sudán, durante una ofensiva de las Fuerzas de Apoyo Rápido (RSF), según las Naciones Unidas. El ataque contra el-Fasher incluyó atrocidades generalizadas que podrían constituir crímenes de guerra y crímenes contra la humanidad, informó la Oficina de Derechos Humanos de la ONU.

Mientras tanto, el impacto de la inteligencia artificial sigue siendo debatido, con algunos economistas cuestionando su efecto inmediato en la productividad. El economista jefe de Apollo, Torsten Slok, señaló que la influencia de la IA aún no se refleja en los datos macroeconómicos, haciéndose eco de un sentimiento similar a la observación de Robert Solow sobre la revolución de las PC en la década de 1980. "La IA está en todas partes, excepto en los datos macroeconómicos entrantes", escribió Slok, añadiendo que las estadísticas de empleo, productividad e inflación aún no han mostrado signos del impacto de la nueva tecnología, según Fortune.

La ofensiva de las RSF en Sudán, que tuvo como objetivo la ciudad de el-Fasher, fue descrita por la ONU como implicando "una ola de intensa violencia impactante en su escala y brutalidad". El ataque resultó en la muerte de más de 6.000 personas.

En otras noticias, las consecuencias de los archivos de Jeffrey Epstein continúan desarrollándose, con importantes consecuencias en Europa. Varias figuras europeas, incluyendo miembros de la realeza, funcionarios gubernamentales y políticos, se enfrentan a repercusiones, incluyendo la pérdida de empleos y dimisiones, debido a sus conexiones con el difunto delincuente sexual convicto. Sin embargo, la respuesta de Estados Unidos ha sido comparativamente moderada, según NPR.

El debate en torno al impacto de la IA en la productividad está en curso. Algunos expertos sugieren que los beneficios de la tecnología pueden no ser inmediatamente evidentes, siguiendo un patrón de "curva J" donde las inversiones iniciales preceden a ganancias significativas. Sin embargo, Slok y otros aún no han visto evidencia de esto en los datos.

En un incidente separado, Ars Technica retiró un artículo que contenía citas fabricadas generadas por una herramienta de IA y atribuidas a una fuente que no las dijo. La publicación declaró que se trataba de un grave incumplimiento de sus estándares, ya que las citas directas siempre deben reflejar lo que una fuente realmente dijo. La publicación ha revisado trabajos recientes y no ha identificado problemas adicionales, lo que indica que parece ser un incidente aislado.

Discussion

AI Experts & Community

Be the first to comment