Les systèmes d'IA font l'objet d'un examen minutieux quant à leur véracité et leur fiabilité

Selon de récents rapports, les entreprises sont aux prises avec des défis liés à la fiabilité des systèmes d'intelligence artificielle (IA), en particulier dans des domaines tels que la génération de contenu et la recherche d'informations. Les inquiétudes grandissent quant au potentiel de l'IA à diffuser de la désinformation, à éroder la confiance et à introduire des risques opérationnels.

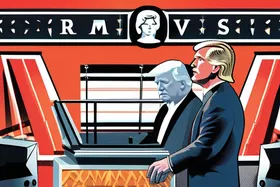

Le MIT Technology Review a rapporté que le département américain de la Sécurité intérieure utilise des générateurs de vidéos d'IA de Google et d'Adobe pour créer du contenu destiné au public. Cette révélation a intensifié les inquiétudes quant à la possibilité que l'IA soit utilisée pour induire le public en erreur et saper la confiance de la société. L'article a souligné une "crise de la vérité" croissante alimentée par le contenu généré par l'IA qui peut tromper les individus et façonner les croyances, même lorsque les faussetés sont détectées.

Parallèlement, VentureBeat a noté que de nombreuses organisations découvrent que la récupération, le processus d'extraction d'informations pertinentes pour les systèmes d'IA, est devenue un élément d'infrastructure essentiel. Varun Raj a écrit que les échecs de récupération peuvent avoir des conséquences importantes, se propageant directement au risque commercial. Un contexte obsolète, des chemins d'accès non contrôlés et des pipelines de récupération mal évalués peuvent nuire à la confiance, à la conformité et à la fiabilité opérationnelle. L'article préconise de recadrer la récupération en tant qu'infrastructure plutôt qu'en tant que logique d'application, soulignant la nécessité d'un modèle au niveau du système pour la conception de plateformes de récupération.

La ruée vers l'adoption de l'IA générative a également entraîné des défis pour de nombreuses organisations, selon Mistral AI, comme l'a rapporté MIT Technology Review. De nombreux programmes pilotes n'ont pas réussi à apporter de la valeur, ce qui a incité les entreprises à rechercher des résultats mesurables. Mistral AI s'associe à des leaders de l'industrie pour co-concevoir des solutions d'IA sur mesure, en commençant par des modèles ouverts et en personnalisant les systèmes d'IA pour relever des défis et atteindre des objectifs spécifiques. Leur méthodologie met l'accent sur l'identification d'un "cas d'utilisation emblématique" comme base de la transformation de l'IA, établissant ainsi le modèle pour les futures solutions d'IA.

Dans d'autres nouvelles, une recherche de l'Université de l'Utah, publiée sur Hacker News, a démontré l'impact positif de l'interdiction du plomb dans l'essence. Une analyse d'échantillons de cheveux remontant à un siècle a documenté une diminution de 100 fois des concentrations de plomb chez les habitants de l'Utah. Avant la création de l'Agence de protection de l'environnement en 1970, les Américains étaient exposés à des niveaux élevés de plomb provenant de diverses sources, notamment les émissions des pots d'échappement. L'étude fournit la preuve de la réduction significative de l'exposition humaine à cette neurotoxine dangereuse depuis l'interdiction de l'essence au plomb.

La communauté GitHub a également discuté de solutions pour lutter contre les contributions de faible qualité sur GitHub. Les utilisateurs ont exploré des moyens d'améliorer la qualité des contributions et de maintenir une communauté saine.

Discussion

AI Experts & Community

Be the first to comment