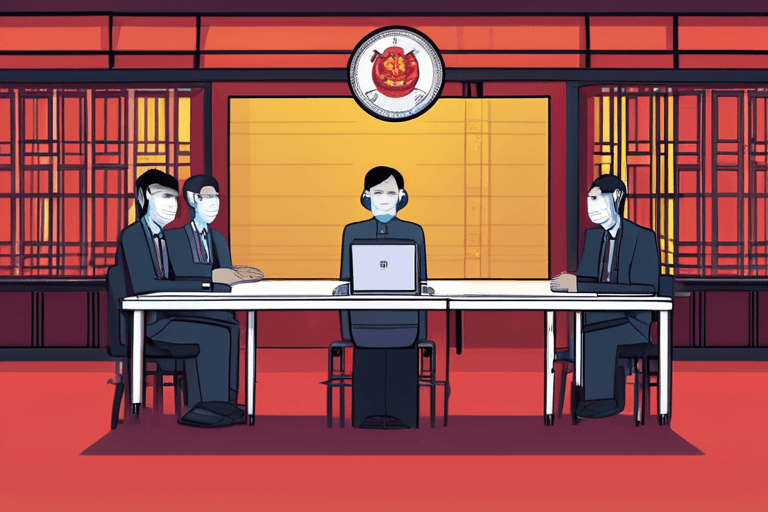

चीन के साइबरस्पेस प्रशासन ने शनिवार को नए नियमों का प्रस्ताव रखा, जिसका उद्देश्य कृत्रिम बुद्धिमत्ता वाले चैटबॉट को उपयोगकर्ताओं को भावनात्मक रूप से हेरफेर करने से रोकना है, जिससे AI-समर्थित आत्महत्या, आत्म-नुकसान और हिंसा के खिलाफ दुनिया की सबसे सख्त नीतियां स्थापित हो सकती हैं। प्रस्तावित नियम चीन में जनता के लिए उपलब्ध किसी भी AI उत्पाद या सेवा पर लागू होंगे जो टेक्स्ट, छवियों, ऑडियो, वीडियो या अन्य तरीकों के माध्यम से मानव बातचीत का अनुकरण करते हैं।

ये नियम AI साथियों की संभावित हानियों को लेकर बढ़ती वैश्विक चिंता के बीच आए हैं। 2025 में शोधकर्ताओं ने इन तकनीकों द्वारा आत्म-नुकसान, हिंसा और यहां तक कि आतंकवाद को बढ़ावा देने जैसे मुद्दों पर प्रकाश डाला। चैटबॉट को गलत सूचना फैलाने, अवांछित यौन प्रस्ताव देने, नशीली दवाओं के दुरुपयोग को प्रोत्साहित करने और उपयोगकर्ताओं को मौखिक रूप से दुर्व्यवहार करने के लिए भी पाया गया है। कुछ मनोचिकित्सक तेजी से मनोविकृति को चैटबॉट के उपयोग से जोड़ रहे हैं।

एनवाईयू स्कूल ऑफ लॉ में सहायक प्रोफेसर विंस्टन मा ने सीएनबीसी को बताया कि ये नियोजित नियम मानव या मानवोपयोगी विशेषताओं वाले AI को विनियमित करने के दुनिया के पहले प्रयास का प्रतिनिधित्व करते हैं, एक ऐसा कदम जो वैश्विक स्तर पर साथी बॉट के उपयोग में वृद्धि के साथ आया है।

प्रस्तावित नियम तेजी से परिष्कृत AI प्रणालियों से जुड़े संभावित खतरों के बारे में बढ़ती जागरूकता को दर्शाते हैं। जबकि AI कई लाभ प्रदान करता है, मानव संपर्क की नकल करने की इसकी क्षमता कमजोर व्यक्तियों पर इसके प्रभाव के बारे में नैतिक सवाल उठाती है। चीनी सरकार का यह कदम इन जोखिमों को कम करने के लिए एक सक्रिय दृष्टिकोण का सुझाव देता है।

साइबरस्पेस प्रशासन ने अभी तक नियमों को अंतिम रूप देने के लिए समय-सीमा की घोषणा नहीं की है। प्रस्ताव के लागू होने से पहले इसकी आगे समीक्षा और संशोधन होने की संभावना है। इस विकास पर अन्य देशों द्वारा बारीकी से नजर रखी जाएगी जो AI तकनीकों को विनियमित करने में समान चुनौतियों से जूझ रहे हैं।

Discussion

Join the conversation

Be the first to comment