政府当局は、イーロン・マスク氏のソーシャルメディアプラットフォームXに対し、同プラットフォームの人工知能チャットボットであるGrokによって生成されたディープフェイクの拡散に対処するよう要求しました。政府は「ぞっとするような」悪用の事例を挙げ、誤った情報の流布や潜在的な危害について懸念を表明しました。

デジタルインテグリティ省(DDI)が水曜日に出したこの要求は、X上で流通している非常にリアルなAI生成の動画や画像に関するユーザーからの報告が急増したことを受けてのものです。DDIによると、これらのディープフェイクは、多くの場合、著名人をフィーチャーしており、虚偽の情報を広めたり、悪意のあるコンテンツを拡散するために使用されています。

DDIのアニヤ・シャルマ長官は、報道声明で「Grokが悪用される可能性について深く懸念しています」と述べました。「技術自体は本質的に有害ではありませんが、Xにおける適切な安全対策の欠如が、悪意のある目的のために悪用されることを許しています。この脅威を軽減するために、直ちに行動を起こす必要があります。」

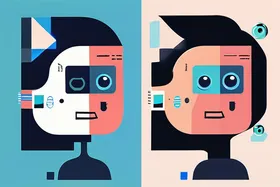

マスク氏のxAIによって開発されたAIチャットボットであるGrokは、X Premium+のサブスクリプション階層に統合されています。質問に答えたり、クリエイティブなコンテンツを生成したり、リアルタイムの情報を提供したりするように設計されています。しかし、リアルな画像や動画を生成する能力は、悪用される可能性について懸念を引き起こしています。

技術専門家は、ディープフェイクは高度な機械学習アルゴリズム、特に深層ニューラルネットワークを利用して、視覚および音声コンテンツを操作または合成すると説明しています。これらのアルゴリズムは、膨大な画像と動画のデータセットでトレーニングされており、説得力のある偽造を作成することができます。これらの技術の比較的低コスト化とアクセシビリティの向上は、ディープフェイクの台頭に貢献しています。

DDIの要求は、強化されたコンテンツモデレーションポリシー、ディープフェイクを識別するための改善された検出アルゴリズム、およびより厳格なユーザー認証プロトコルを含む、いくつかの重要な分野に焦点を当てています。政府はまた、プラットフォーム上でのAI生成コンテンツの使用に関する透明性の向上も求めています。

Xは、DDIの要求に対し、懸念を認める声明を発表しました。「私たちは、当社のプラットフォーム上のディープフェイクの問題に対処することに尽力しています」と声明には書かれています。「悪意のあるAI生成コンテンツを検出し、削除するための新しい技術の開発と展開に積極的に取り組んでいます。また、ユーザー認証を強化し、責任あるAIの使用を促進する方法も模索しています。」

業界アナリストは、この事件はAI生成コンテンツの規制における課題がますます大きくなっていることを浮き彫りにしていると指摘しています。スタンフォード大学のAI倫理学教授であるベン・カーター博士は、「AI技術の進歩のスピードは、効果的な規制の枠組みを開発する能力を上回っています」と述べています。「これらの課題に対処するには、政府、産業界、学界の間の協力を含む多面的なアプローチが必要です。」

DDIは、ディープフェイクの問題に対処するための提案された対策の概要を示す詳細な計画を提出するよう、Xに2週間の期限を与えました。DDIによると、これに従わない場合、罰金またはその他の規制措置が科される可能性があります。状況は流動的であり、Xが政府の要求に応じるにつれて、今後数日間でさらなる展開が予想されます。

Discussion

Join the conversation

Be the first to comment