По мнению экспертов, опрошенных журналом Nature, искусственный интеллект готов преобразовать многие аспекты современной жизни, от здравоохранения и национальной безопасности до потребительских товаров и научных исследований. Эта область, обладая огромным потенциалом, также сталкивается с дезинформацией и конфликтующими интересами.

Люди, находящиеся на передовой разработок в области ИИ, размышляют о последствиях этой технологии для своих областей и общества в целом, а также о потенциальных социальных проблемах. Эти идеи были запечатлены в видеоролике, созданном при финансовой поддержке FII Institute, при этом Nature сохранял редакционную независимость.

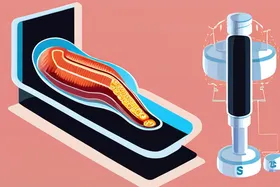

В основе ИИ лежат алгоритмы, позволяющие машинам учиться на данных, выявлять закономерности и принимать решения с минимальным вмешательством человека. Эта возможность привела к прорывам в таких областях, как медицинская диагностика, где ИИ может анализировать медицинские изображения для более раннего и точного выявления заболеваний. В сфере национальной безопасности ИИ используется для анализа огромных объемов данных с целью выявления потенциальных угроз и повышения кибербезопасности.

Однако быстрое развитие ИИ также вызывает опасения по поводу потери рабочих мест, алгоритмической предвзятости и возможности злоупотреблений. Алгоритмическая предвзятость, например, может увековечивать и усиливать существующее социальное неравенство, если данные, используемые для обучения систем ИИ, отражают эти предубеждения. Опрошенные эксперты подчеркнули важность упреждающего решения этих проблем, чтобы ИИ приносил пользу всему обществу.

Разработка ИИ – это не только технологическое начинание; это процесс, управляемый человеком. Выбор, сделанный разработчиками ИИ, исследователями и политиками, определит траекторию развития технологии и ее влияние на общество. Эксперты подчеркнули необходимость междисциплинарного сотрудничества с участием специалистов по этике, социологов и политиков для руководства ответственной разработкой и внедрением ИИ.

К последним разработкам в области ИИ относится появление больших языковых моделей (LLM), таких как ChatGPT, которые могут генерировать текст, сопоставимый по качеству с человеческим, и участвовать в беседах. Эти модели продемонстрировали впечатляющие возможности в различных задачах, но они также вызывают опасения по поводу распространения дезинформации и возможности злоупотреблений.

Будущее ИИ зависит от решения этих проблем и обеспечения того, чтобы технология разрабатывалась и использовалась таким образом, чтобы соответствовать человеческим ценностям и способствовать общественному благополучию. Постоянный диалог между экспертами, политиками и общественностью имеет решающее значение для формирования будущего ИИ и использования его потенциала во благо.

Discussion

Join the conversation

Be the first to comment