أعرب مقر رئاسة الوزراء في 10 داونينج ستريت عن استحسانه للتقارير التي تشير إلى أن منصة X، المعروفة سابقًا باسم تويتر، تتخذ خطوات لمعالجة مشكلة التزييف العميق (deepfakes) التي يتم إنشاؤها بواسطة Grok، نموذج الذكاء الاصطناعي الخاص بها. تأتي هذه الخطوة وسط مخاوف متزايدة بشأن احتمال إساءة استخدام المحتوى الناتج عن الذكاء الاصطناعي لنشر المعلومات المضللة والدعاية.

وذكر متحدث باسم رئيس الوزراء أن الحكومة ترحب بأي جهود لتخفيف المخاطر المرتبطة بتقنيات الذكاء الاصطناعي المتقدمة. وقال المتحدث: "لقد كنا واضحين بشأن الحاجة إلى الابتكار المسؤول في مجال الذكاء الاصطناعي، ونحن نشجع الشركات على اتخاذ خطوات استباقية لمعالجة الأضرار المحتملة".

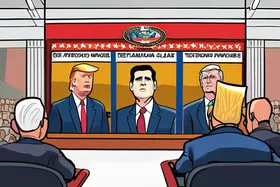

التزييف العميق (Deepfakes)، وهي كلمة منحوتة من "التعلم العميق" (deep learning) و "التزييف" (fake)، هي وسائط اصطناعية يتم فيها استبدال شخص في صورة أو مقطع فيديو موجود بشخص آخر. Grok، نموذج الذكاء الاصطناعي الخاص بمنصة X، قادر على إنشاء صور ومقاطع فيديو واقعية، مما يثير مخاوف من إمكانية استخدامه لإنشاء صور أو أحداث مقنعة ولكنها كاذبة للأفراد أو الأحداث. تعتمد هذه التقنية على الشبكات التوليدية الخصومية (GANs)، وهو نوع من بنية تعلم الآلة حيث تتنافس شبكتان عصبيتان مع بعضهما البعض - إحداهما تولد محتوى مزيفًا والأخرى تحاول تمييزه عن المحتوى الحقيقي - حتى يصبح المحتوى الذي تم إنشاؤه واقعيًا للغاية.

لم تكشف منصة X بعد عن تفاصيل محددة حول الإجراءات التي تنفذها لمكافحة التزييف العميق (deepfakes) الذي يتم إنشاؤه بواسطة Grok. ومع ذلك، يتكهن محللو الصناعة بأن الشركة قد تستكشف تقنيات مثل وضع علامات مائية على المحتوى الذي يتم إنشاؤه بواسطة الذكاء الاصطناعي، وتطوير خوارزميات لاكتشاف التزييف العميق (deepfakes)، وتنفيذ سياسات أكثر صرامة للإشراف على المحتوى. يتضمن وضع العلامات المائية تضمين علامة دقيقة، غالبًا ما تكون غير مرئية، في المحتوى الذي تم إنشاؤه والتي تحدده على أنه تم إنشاؤه بواسطة الذكاء الاصطناعي. تحلل خوارزميات الكشف الصور ومقاطع الفيديو بحثًا عن علامات تدل على التلاعب، مثل التناقضات في الإضاءة أو حركات الوجه غير الطبيعية أو التشوهات التي أدخلتها عملية الشبكات التوليدية الخصومية (GANs).

أثار ظهور التزييف العميق (deepfakes) قلقًا واسع النطاق في مختلف القطاعات، بما في ذلك السياسة والإعلام والترفيه. يحذر الخبراء من أن التزييف العميق (deepfakes) يمكن استخدامه للتلاعب بالرأي العام وتشويه السمعة وحتى التحريض على العنف. إن احتمالية إساءة الاستخدام حادة بشكل خاص في سياق الانتخابات، حيث يمكن استخدام التزييف العميق (deepfakes) لنشر معلومات كاذبة حول المرشحين أو التأثير على إقبال الناخبين.

تدرس حكومة المملكة المتحدة بنشاط الأطر التنظيمية للذكاء الاصطناعي، بما في ذلك تدابير لمعالجة المخاطر المرتبطة بالتزييف العميق (deepfakes). يتضمن قانون السلامة على الإنترنت، الذي دخل حيز التنفيذ مؤخرًا، أحكامًا لمعالجة المحتوى الضار عبر الإنترنت، بما في ذلك التزييف العميق (deepfakes). وتعمل الحكومة أيضًا مع شركاء دوليين لتطوير معايير عالمية لحوكمة الذكاء الاصطناعي.

يبقى أن نرى ما هي الإجراءات المحددة التي ستتخذها منصة X لمعالجة التزييف العميق (deepfakes) الذي يتم إنشاؤه بواسطة Grok ومدى فعالية هذه الإجراءات. ومن المتوقع أن تصدر الشركة مزيدًا من التفاصيل في الأسابيع المقبلة. من المحتمل أن تعتمد فعالية أي حل على مدى تطور طرق الكشف والسرعة التي يمكن لمنصة X الاستجابة بها للتهديدات الناشئة. يتطلب التطوير المستمر ونشر تقنيات الذكاء الاصطناعي يقظة مستمرة وتكيفًا للبقاء في صدارة أي إساءة استخدام محتملة.

Discussion

Join the conversation

Be the first to comment