AI 감시 강화: HHS, DEI 심사에 Palantir 사용, Epstein 파일 공개, AI 진실성 우려 증가

보건복지부(HHS)가 최근 발표한 2025년 HHS의 AI 사용 현황에 따르면, HHS는 Palantir의 인공지능 도구를 사용하여 도널드 트럼프 전 대통령의 다양성, 형평성, 포용성(DEI) 이니셔티브 및 젠더 이데올로기를 표적으로 삼는 행정 명령 준수 여부를 심사하기 위해 보조금 및 직무 기술서를 검토했습니다. 이러한 사실은 법무부가 유죄 판결을 받은 성범죄자 제프리 엡스타인과 관련된 약 350만 페이지 분량의 파일을 공개하여 기술 업계의 저명한 인사들과의 관계를 밝히고, AI가 사회적 신뢰를 약화시킬 가능성에 대한 우려가 커지는 가운데 밝혀졌습니다.

Wired에 따르면 HHS는 2025년 3월부터 Palantir의 AI 도구를 사용하여 보조금, 보조금 신청서 및 직무 기술서를 감사했습니다. Palantir와 HHS 모두 이 회사의 소프트웨어 사용에 대해 공개적으로 발표하지 않았습니다. 트럼프 대통령의 두 번째 임기 동안 Palantir는 HHS로부터 3,500만 달러 이상의 지급 및 의무를 받았지만, 이러한 거래에 대한 설명에는 DEI 또는 젠더 이데올로기 표적화에 대한 언급은 없었습니다.

2025년 11월 19일의 엡스타인 파일 투명성 법에 따라 의무화된 엡스타인 파일 공개는 엡스타인과 기술 업계 개인 간의 관계에 대한 새로운 조사를 불러일으켰습니다. Microsoft 공동 창업자 빌 게이츠와 같이 일부는 오랫동안 엡스타인과 관련이 있었지만, 일론 머스크와 같은 다른 사람들은 파일 공개 이전에 덜 확립된 관계를 가졌다고 Wired는 보도했습니다. 엡스타인 파일에 이름이 있다고 해서 반드시 부정 행위를 의미하는 것은 아니라는 점에 유의하는 것이 중요합니다.

한편, AI가 "진실 위기"에 기여할 가능성에 대한 우려가 커지고 있습니다. MIT Technology Review는 미국 국토안보부가 Google 및 Adobe의 AI 비디오 생성기를 사용하여 대중 소비를 위한 콘텐츠를 만들고 있다고 보도했습니다. 이 소식은 AI 생성 콘텐츠가 대중을 속이고, 신념을 형성하고, 사회적 신뢰를 약화시킬 가능성에 대한 우려를 불러일으켰습니다. 이 기사는 또한 이 위기에 대처하기 위해 처음 의도된 도구가 부적절한 것으로 판명되고 있다고 언급했습니다.

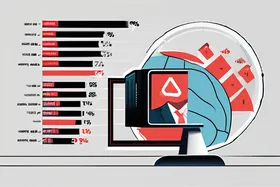

엔터프라이즈 AI 분야에서 VentureBeat는 기업들이 대규모 언어 모델(LLM)을 독점 데이터에 기반하도록 하기 위해 검색 증강 생성(RAG)을 점점 더 많이 채택하고 있다고 보도합니다. 그러나 많은 조직에서 검색이 모델 추론에 볼트로 고정된 기능이 아니라 기본적인 시스템 종속성이 되었다는 것을 알게 되었습니다. 검색 실패는 신뢰, 규정 준수 및 운영 안정성을 저해할 수 있습니다. VentureBeat는 "부실한 컨텍스트, 관리되지 않는 액세스 경로 및 제대로 평가되지 않은 검색 파이프라인은 답변 품질을 저하시킬 뿐만 아니라 신뢰, 규정 준수 및 운영 안정성을 저해합니다."라고 언급했습니다.

Asana CPO Arnab Bose는 기업 내에서 성공적인 AI 에이전트를 위한 공유 메모리 및 컨텍스트의 중요성을 강조했습니다. 그는 최근 샌프란시스코에서 열린 VB 행사에서 AI 에이전트에게 자세한 기록과 직접 액세스를 제공하고 안전 장치 검문소와 인간의 감독을 제공하면 활성 팀원으로 기능할 수 있다고 말했습니다. Bose는 "이러한 방식으로 작업을 할당할 때 비즈니스 작동 방식에 대한 모든 컨텍스트를 다시 제공할 필요가 없습니다."라고 말했습니다. Asana는 AI 에이전트가 팀과 프로젝트에 직접 통합되는 협업 시스템을 만드는 것을 목표로 작년에 Asana AI Teammates를 출시했습니다.

Discussion

AI 전문가 & 커뮤니티

첫 댓글을 남겨보세요