Даунинг-стрит, 10 выразила одобрение сообщениям о том, что X, ранее известная как Twitter, предпринимает шаги для решения проблемы дипфейков, сгенерированных Grok, ее моделью искусственного интеллекта. Этот шаг предпринят на фоне растущей обеспокоенности по поводу потенциального злоупотребления контентом, созданным ИИ, для распространения дезинформации и пропаганды.

Представитель премьер-министра заявил, что правительство приветствует любые усилия по смягчению рисков, связанных с передовыми технологиями ИИ. «Мы четко заявили о необходимости ответственных инноваций в области ИИ, и мы рады видеть, что компании предпринимают активные шаги для устранения потенциального вреда», — сказал представитель.

Дипфейки, образованные от слов «deep learning» (глубокое обучение) и «fake» (подделка), — это синтетические медиа, в которых человек на существующем изображении или видео заменяется чьим-то другим подобием. Grok, модель ИИ от X, способна генерировать реалистичные изображения и видео, что вызывает опасения, что ее можно будет использовать для создания убедительных, но ложных изображений отдельных лиц или событий. Эта технология основана на генеративно-состязательных сетях (GAN), типе архитектуры машинного обучения, где две нейронные сети конкурируют друг с другом — одна генерирует поддельный контент, а другая пытается отличить его от реального контента — до тех пор, пока сгенерированный контент не станет очень реалистичным.

X пока не опубликовала конкретных деталей о мерах, которые она реализует для борьбы с дипфейками, сгенерированными Grok. Однако отраслевые аналитики предполагают, что компания может изучать такие методы, как нанесение водяных знаков на контент, сгенерированный ИИ, разработка алгоритмов для обнаружения дипфейков и внедрение более строгой политики модерации контента. Нанесение водяных знаков включает в себя встраивание тонкого, часто невидимого, маркера в сгенерированный контент, который идентифицирует его как сгенерированный ИИ. Алгоритмы обнаружения анализируют изображения и видео на предмет характерных признаков манипуляций, таких как несоответствия в освещении, неестественные движения лица или артефакты, привнесенные процессом GAN.

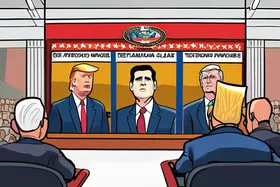

Рост числа дипфейков вызвал широкую обеспокоенность в различных секторах, включая политику, СМИ и развлечения. Эксперты предупреждают, что дипфейки могут быть использованы для манипулирования общественным мнением, нанесения ущерба репутации и даже подстрекательства к насилию. Потенциал для злоупотреблений особенно остро стоит в контексте выборов, где дипфейки могут быть использованы для распространения ложной информации о кандидатах или влияния на явку избирателей.

Правительство Великобритании активно рассматривает нормативно-правовую базу для ИИ, включая меры по устранению рисков, связанных с дипфейками. Закон о безопасности в Интернете, который недавно вступил в силу, включает положения о борьбе с вредоносным онлайн-контентом, включая дипфейки. Правительство также работает с международными партнерами над разработкой глобальных стандартов управления ИИ.

Пока неясно, какие конкретные действия предпримет X для решения проблемы дипфейков Grok и насколько эффективными будут эти меры. Ожидается, что компания опубликует более подробную информацию в ближайшие недели. Эффективность любого решения, вероятно, будет зависеть от сложности методов обнаружения и скорости, с которой X сможет реагировать на возникающие угрозы. Постоянная разработка и развертывание технологий ИИ требует постоянной бдительности и адаптации, чтобы опережать потенциальные злоупотребления.

Discussion

Join the conversation

Be the first to comment