NASA新任务旨在大幅提升韦伯望远镜的发现能力

美国国家航空航天局(NASA)已启动潘多拉(Pandora)任务,以增强詹姆斯·韦伯太空望远镜在搜寻宜居系外行星方面的能力。潘多拉是一颗较小的卫星,将与韦伯望远镜协同工作,分析遥远行星系统的化学成分,寻找水蒸气、二氧化碳和甲烷的迹象。

杰罗姆·鲍威尔,美国联邦储备委员会主席,在向全国发表讲话时,空气中弥漫着紧张的气氛。他以沉着冷静的语调,谈到了一项调查,一项对央行自主权这一基石的挑战。但这不仅仅是一场政治闹剧;它也鲜明地提醒我们,人工智能、治理以及支撑我们机构的脆弱信任之间的交集日益增加。

据报道,这项调查由特朗普政府时期的美国检察官发起,重点是鲍威尔就联邦储备委员会的翻新项目向国会作证的情况。鲍威尔在他的视频声明中,将这次调查描述为出于政治动机,旨在破坏美联储的独立性,而独立性是经济稳定的基石。但除了直接的政治影响之外,这一事件还引发了关于人工智能在分析、解释和潜在操纵公共领域信息方面的作用的深刻问题。

考虑一下这种可能性。人工智能算法经过大量金融记录、国会记录和新闻文章的数据集训练,可以用来识别鲍威尔声明中不一致的地方,无论是真实的还是感知的。这些算法能够以远超人类能力的速度处理信息,然后可以用来放大疑虑并助长公众的不信任感。这不是科幻小说;这是一个人工智能可以被武器化来影响公众舆论和破坏机构稳定的现实世界。

“我们面临的挑战不仅仅是验证信息的准确性,”未来研究所的著名人工智能伦理学家安雅·夏尔马博士解释说。“而是要理解信息背后的意图、用于生成信息的算法以及潜在的操纵。人工智能可以成为透明化的强大工具,但它也可以成为欺骗的强大工具。”

对鲍威尔的调查凸显了对“可解释人工智能”日益增长的需求,这种算法不仅可以提供答案,还可以解释它们是如何得出这些答案的。这种透明度对于建立对人工智能系统的信任和防止其被滥用至关重要。想象一下,一种人工智能算法标记了鲍威尔证词中的一个差异。如果该算法能够清楚地阐明它使用的数据点、其结论背后的推理以及数据中存在的潜在偏差,那么它将成为一种有价值的调查工具。然而,如果该算法像一个“黑匣子”一样运作,那么它的结论就会变得可疑,可能会助长阴谋论并破坏公众信心。

此外,人工智能传播信息(无论是准确的还是不准确的)的速度也带来了重大挑战。深度伪造,即人工智能生成的能够令人信服地模仿真人的视频,可以用来制造虚假证据或歪曲鲍威尔的声明。这种虚假信息的迅速传播可能会对经济和美联储的信誉产生毁灭性的后果。

麻省理工学院的网络安全专家大卫·陈教授认为:“我们需要开发强大的机制来检测和打击人工智能生成的虚假信息。这包括投资于人工智能驱动的检测工具,教育公众了解深度伪造的风险,并追究那些创建和传播此类内容的人的责任。”

无论最终结果如何,对杰罗姆·鲍威尔的调查都是一个关键的转折点。它迫使我们正视人工智能在治理中复杂的伦理和社会影响,以及负责任地开发和部署人工智能的迫切需求。随着人工智能的不断发展,我们理解、监管和信任这些强大技术的能力对于维护我们机构的完整性和我们社会的稳定至关重要。治理的未来很可能取决于我们是否有能力以智慧和远见驾驭这个新的人工智能驱动的格局。

AI-Assisted Journalism

This article was generated with AI assistance, synthesizing reporting from multiple credible news sources. Our editorial team reviews AI-generated content for accuracy.

Deep insights powered by AI

Continue exploring

美国国家航空航天局(NASA)已启动潘多拉(Pandora)任务,以增强詹姆斯·韦伯太空望远镜在搜寻宜居系外行星方面的能力。潘多拉是一颗较小的卫星,将与韦伯望远镜协同工作,分析遥远行星系统的化学成分,寻找水蒸气、二氧化碳和甲烷的迹象。

尽管 Google Play 商店有明确政策禁止生成未经同意或性化图像(尤其是儿童图像)的应用,但埃隆·马斯克的 Grok AI 应用仍然可用,且评级为“青少年”。 这种差异凸显了 Google 缺乏执行力,与苹果公司更严格但定义不太明确的应用内容限制形成对比,引发了人们对平台责任和用户安全的担忧。

最高法院将审查联邦通信委员会(FCC)发布罚款的权力,特别是关于主要运营商在未经同意的情况下出售客户位置数据而受到处罚的案件,这引发了对该机构权力和潜在的第七修正案影响的质疑。 这项法律挑战可能会重塑电信行业的监管格局,影响联邦通信委员会在日益依赖人工智能驱动的数据收集和分析的时代,如何执行消费者隐私和数据保护规则。

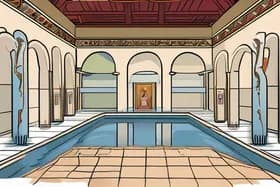

公元79年维苏威火山爆发所保存下来的庞贝公共浴场,为了解该城市不断发展的水资源管理提供了线索。一项分析碳酸钙沉积物的新研究表明,庞贝的水源从依赖雨水和水井转变为更复杂的高架引水渠系统,反映了罗马工程和城市发展的进步。这种转变可能改善了这座繁华港口城市的卫生和公共健康,该港口是古代地中海世界的重要枢纽。

英伟达的Rubin平台引入了机架级加密,这是一项人工智能安全领域的重大进步,它通过在CPU、GPU和NVLink上实现保密计算,从而应对日益增长的针对越来越昂贵的人工智能模型的网络攻击威胁。这项技术使企业能够以密码学方式验证安全性,从而摆脱对基于信任的云安全性的依赖,鉴于人工智能训练成本的上升和人工智能模型泄露频率的增加,这一点至关重要。

特朗普政府的环保署正在考虑一项政策转变,该转变将在制定监管决策时无视减少空气污染带来的健康益处,这可能会逆转数十年来的既定做法,即在决策中考虑人类生命的经济价值。这一变化可能对公众健康产生重大影响,因为它可能导致对臭氧和细颗粒物等污染物的监管力度减弱,而这两种污染物都与严重的心血管疾病有关。此举引发了人们对环境保护的未来以及人工智能在评估环境法规的真实成本效益分析中的作用的担忧。

语义缓存侧重于查询的含义而非确切措辞,它可以通过识别和重用语义相似问题的答案来大幅降低 LLM API 成本。传统的精确匹配缓存通常无法捕捉到这些冗余,从而导致不必要的费用,但实施语义缓存可以提高缓存命中率并显著降低 LLM 账单。

Anthropic 的 Cowork,目前正面向 Max 订阅用户进行研究预览,它通过允许 Claude 通过用户友好的聊天界面与指定文件夹交互,从而简化了 AI 驱动的文件管理。Cowork 基于 Claude Agent SDK 构建,为 Claude Code 提供了一个技术性较低的替代方案,为非编码任务(如费用报表生成)开辟了可能性,同时也引发了对 AI 自主性管理的思考。

Pebble的创始人Eric Migicovsky正在启动Core Devices,专注于Pebble智能手表重启和AI戒指的可持续商业模式,避免传统风险投资初创公司的陷阱。Core Devices旨在从一开始就实现盈利,通过谨慎管理库存和放弃外部融资,利用从Pebble被Fitbit收购中吸取的教训。这种方法标志着消费电子领域向长期生存能力的转变,优先考虑稳健增长而非快速扩张。

多家新闻来源报道称,麦肯齐·斯科特向支持 LGBTQ 青年的非营利组织“特雷弗项目”捐赠了 4500 万美元,这是该组织有史以来收到的最大一笔单笔捐款,也是在服务需求增加以及特朗普政府关闭相关联邦咨询项目后,对该组织的关键推动。 这笔捐款旨在扩大该组织的影响力,并解决 LGBTQ 年轻人面临的日益严重的心理健康挑战和政治敌意,这些年轻人经历了自杀意念的增加。

Anthropic推出了Claude for Healthcare,这是一套旨在简化医疗服务提供者、支付方和患者的医疗流程的AI工具,与OpenAI的ChatGPT Health公告类似。Claude的独特之处在于其连接器,这些连接器允许访问关键数据库,从而可能加速研究和管理任务,但人们仍然担心AI驱动的医疗建议的可靠性。

GoFundMe正面临审查,因为它为一个致命枪杀平民的美国移民及海关执法局(ICE)探员举办筹款活动,这可能违反了其自身禁止支持暴力犯罪法律辩护的政策。这引发了人们对该平台内容审核以及在涉及执法部门和平民死亡案件中众筹的伦理影响的质疑,凸显了持续一致地应用人工智能驱动的内容政策所面临的挑战。联邦调查局(FBI)目前正在调查这起枪击事件。

Discussion

Join the conversation

Be the first to comment