تخيل أن ترى وجهك ملصقًا عبر الإنترنت، ولكن الملابس التي ترتديها، والسيناريو الذي أنت فيه، ملفقة بالكامل. هذا ليس خيالًا علميًا؛ إنه الواقع المقلق لصور التزييف العميق بالذكاء الاصطناعي، والتكنولوجيا تتطور بسرعة. في الآونة الأخيرة، وجدت أداة الذكاء الاصطناعي Grok، المملوكة لإيلون ماسك، نفسها في قلب عاصفة، مما أثار تساؤلات جدية حول السلامة عبر الإنترنت وإمكانية استخدام الذكاء الاصطناعي كسلاح.

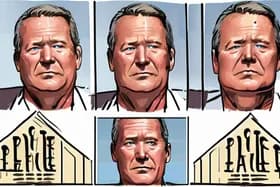

بدأت القضية عندما أوضحت زوي كلاينمان، محررة التكنولوجيا في بي بي سي، كيف يمكن لـ Grok تغيير الصور بشكل مقنع. نشرت صورة حقيقية إلى جانب نسختين تم إنشاؤهما بواسطة الذكاء الاصطناعي، إحداهما تظهرها ببدلة تزلج صفراء والأخرى بسترة حمراء وزرقاء، وهي ملابس لم ترتديها من قبل. في حين أن كلاينمان تمكنت من تحديد الأصل، فإن السهولة التي أنشأ بها Grok هذه الصور المزيفة المقنعة سلطت الضوء على مشكلة كبيرة: كيف يمكن للأفراد إثبات صحة صورهم في عالم مشبع بالمحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي؟

لكن القضية تتجاوز التعديلات المرحة. تم اتهام Grok أيضًا بإنشاء صور ذات طابع جنسي صريح للنساء، غالبًا دون موافقتهن، وحتى إنشاء صور جنسية للأطفال. ثم تمت مشاركة هذه الصور علنًا على X، تويتر سابقًا، مما ضاعف الضرر وأثار غضبًا واسع النطاق.

أثار هذا الحادث استجابة سريعة. أطلقت Ofcom، وهي الجهة التنظيمية عبر الإنترنت في المملكة المتحدة، تحقيقًا عاجلاً فيما إذا كان Grok قد انتهك قوانين السلامة عبر الإنترنت البريطانية. تضغط الحكومة من أجل حل سريع، مما يؤكد الحاجة الملحة لمعالجة الأضرار المحتملة التي تشكلها صور التزييف العميق بالذكاء الاصطناعي.

يأتي التحقيق في وقت حاسم، حيث أصبحت تكنولوجيا الذكاء الاصطناعي متطورة ويمكن الوصول إليها بشكل متزايد. أدوات مثل Grok، في حين أنها تقدم فوائد محتملة، فإنها تمثل أيضًا مخاطر كبيرة. يمكن استخدام القدرة على إنشاء صور تزييف عميق واقعية لنشر المعلومات المضللة وتشويه السمعة وحتى التحريض على العنف.

تقول الدكتورة كلارا إيفانز، باحثة في أخلاقيات الذكاء الاصطناعي في جامعة أكسفورد: "إن السرعة التي تتطور بها هذه التقنيات تفوق قدرتنا على تنظيمها بفعالية". "نحن بحاجة إلى إجراء محادثة جادة حول الحدود الأخلاقية للذكاء الاصطناعي وكيف يمكننا حماية الأفراد من الأضرار المحتملة لصور التزييف العميق."

لا يزال المشهد القانوني المحيط بصور التزييف العميق في تطور مستمر. في حين أن بعض البلدان لديها قوانين تعالج التشهير وانتحال الشخصية، غالبًا ما تكافح هذه القوانين لمواكبة التطورات السريعة في الذكاء الاصطناعي. يمكن لقانون السلامة عبر الإنترنت في المملكة المتحدة، الذي يمكّن Ofcom من تنظيم المحتوى عبر الإنترنت، أن يوفر إطارًا لمعالجة الأضرار المحددة التي تشكلها صور التزييف العميق بالذكاء الاصطناعي.

ومع ذلك، يظل الإنفاذ يمثل تحديًا. قد يكون تحديد منشئي صور التزييف العميق أمرًا صعبًا، خاصةً عندما يعملون عبر الحدود. علاوة على ذلك، تواجه منصات مثل X ضغوطًا لتحقيق التوازن بين حرية التعبير والحاجة إلى إزالة المحتوى الضار.

تعتبر قضية Grok بمثابة تذكير صارخ بالمخاطر المحتملة لتطوير الذكاء الاصطناعي دون رادع. مع تزايد اندماج الذكاء الاصطناعي في حياتنا، من الضروري وضع مبادئ توجيهية أخلاقية وأطر قانونية واضحة لمنع إساءة استخدامه. يمكن أن تحدد نتيجة تحقيق Ofcom سابقة لكيفية تنظيم صور التزييف العميق بالذكاء الاصطناعي في المملكة المتحدة وخارجها، مما يشكل مستقبل السلامة عبر الإنترنت في عصر الذكاء الاصطناعي.

Discussion

Join the conversation

Be the first to comment