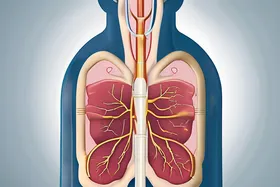

وفقًا لـ OpenAI، يتوجه ما يقدر بنحو 230 مليون شخص أسبوعيًا إلى ChatGPT للاستفسارات المتعلقة بالصحة. تأتي هذه الزيادة في البحث عن المعلومات الصحية المدفوعة بالذكاء الاصطناعي في الوقت الذي أطلقت فيه OpenAI مؤخرًا منتجها ChatGPT Health في وقت سابق من هذا الشهر. السؤال المركزي الآن هو ما إذا كان بالإمكان تقليل المخاطر الكامنة في استخدام الذكاء الاصطناعي للحصول على المشورة الطبية بشكل كافٍ لتوفير تأثير إيجابي صافٍ على الصحة العامة.

يتبع صعود روبوتات الدردشة المدعومة بالذكاء الاصطناعي للحصول على المعلومات الصحية اتجاهًا للأفراد الذين يبحثون عن المشورة الطبية عبر الإنترنت، وهي ممارسة يشار إليها غالبًا باسم "دكتور جوجل". على مدار عقدين من الزمن، كان البحث عن الأعراض عبر الإنترنت خطوة أولى شائعة لأولئك الذين يعانون من مشاكل طبية. ومع ذلك، أصبحت نماذج اللغة الكبيرة (LLMs) بشكل متزايد الأداة المفضلة للكثيرين.

تداعيات استخدام الذكاء الاصطناعي للحصول على المشورة الصحية كبيرة. في حين أن الذكاء الاصطناعي يوفر إمكانية الحصول على معلومات سريعة وسهلة الوصول، إلا أن المخاوف لا تزال قائمة بشأن الدقة وخصوصية البيانات واحتمال التشخيص الخاطئ أو العلاج الذاتي غير المناسب. يؤكد الخبراء على أهمية التحقق من المعلومات الصحية التي يتم إنشاؤها بواسطة الذكاء الاصطناعي مع متخصصين طبيين مؤهلين.

في غضون ذلك، في الولايات المتحدة، تدور معركة حول تنظيم الذكاء الاصطناعي. تصاعدت التوترات في أواخر عام 2025 عندما، بعد فشل الكونجرس مرتين في تمرير تشريع يحظر قوانين الذكاء الاصطناعي للولايات، وقع الرئيس آنذاك دونالد ترامب أمرًا تنفيذيًا يهدف إلى منع الولايات من تنظيم صناعة الذكاء الاصطناعي سريعة النمو، وفقًا لتقريرGrace Huckins. تسلط هذه الخطوة الضوء على النقاش الدائر حول المستوى المناسب من الرقابة الحكومية اللازمة لتحقيق التوازن بين الابتكار والمخاطر المحتملة. يتركز الصراع على المدى الذي يجب أن تتمتع به الولايات الفردية من سلطة لتنفيذ لوائح الذكاء الاصطناعي الخاصة بها، مقابل نهج فيدرالي أكثر توحيدًا.

Discussion

Join the conversation

Be the first to comment