La seguridad de la IA se queda atrás de la adopción, dejando las cadenas de suministro vulnerables

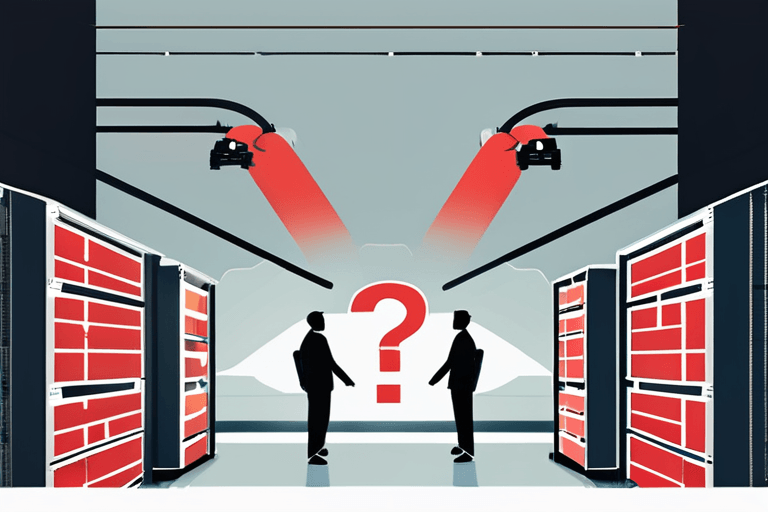

Las empresas se enfrentan a una amenaza creciente de la inteligencia artificial, ya que la adopción de agentes de IA supera las medidas de seguridad, lo que crea vulnerabilidades significativas en las cadenas de suministro de IA. Según una investigación del Informe del Índice 2025 de la Universidad de Stanford, si bien cuatro de cada diez aplicaciones empresariales contarán con agentes de IA específicos para tareas este año, solo el 6% de las organizaciones tienen una estrategia avanzada de seguridad de la IA implementada.

La rápida integración de la IA, en particular los modelos de lenguaje grandes (LLM), ha creado una "brecha de visibilidad" con respecto a cómo, dónde, cuándo y a través de qué flujos de trabajo y herramientas se utilizan o modifican estos modelos, informó VentureBeat. Esta falta de transparencia, junto con la ausencia de listas de materiales de software de modelos (SBOM), deja a las organizaciones expuestas a amenazas impredecibles de la IA.

Palo Alto Networks predice que 2026 traerá las primeras demandas importantes que responsabilizarán personalmente a los ejecutivos por las acciones descontroladas de la IA, lo que destaca la urgencia de mejorar la gobernanza de la IA. La naturaleza acelerada e impredecible de las amenazas de la IA significa que los enfoques de gobernanza tradicionales, como el aumento de los presupuestos o el número de empleados, son insuficientes.

Un CISO describió las listas de materiales de software de modelos (SBOM) como "el Salvaje Oeste de la gobernanza actual", lo que subraya la actual falta de estandarización y supervisión en esta área crítica. Los expertos enfatizan la necesidad de que las organizaciones prioricen la visibilidad de la cadena de suministro de la IA para mitigar los riesgos potenciales y evitar repercusiones legales.

Discussion

Join the conversation

Be the first to comment