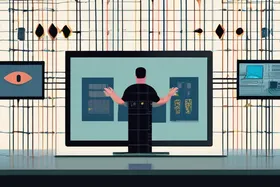

Anthropic, Claude AI 무단 액세스 차단

Anthropic은 타사 애플리케이션을 통한 Claude AI 모델의 무단 액세스를 방지하고 경쟁 AI 연구소가 Claude를 사용하여 경쟁 시스템을 훈련하는 것을 제한하기 위해 기술적 안전 장치를 구현하고 있습니다. 이러한 조치는 가격 및 사용량 제한을 보호하기 위한 것이지만 일부 사용자의 워크플로를 방해하고 의도치 않은 계정 정지로 이어져 AI 접근성과 책임감 있는 사용 및 경쟁 간의 균형을 맞추는 데 어려움을 보여줍니다. 이러한 움직임은 강력한 AI 모델에 대한 접근 통제의 중요성과 더 넓은 AI 생태계에 미치는 영향을 강조합니다.

Discussion

대화에 참여하세요

첫 댓글을 남겨보세요