OpenAI lanzó recientemente ChatGPT Health, un nuevo producto diseñado para brindar consejos de salud, en medio de crecientes preocupaciones sobre la fiabilidad de la información médica impulsada por la IA. El lanzamiento, que tuvo lugar a principios de este mes, se produce en un momento en que se estima que 230 millones de personas por semana ya están utilizando ChatGPT para consultas relacionadas con la salud, según OpenAI. Este desarrollo llega en un momento en que el uso de la IA para el asesoramiento médico está bajo un mayor escrutinio.

La presentación de ChatGPT Health se vio ensombrecida por un informe de SFGate que detallaba la muerte de un adolescente, Sam Nelson, quien, según los informes, buscó el consejo de ChatGPT sobre la combinación de drogas antes de sufrir una sobredosis el año pasado. Este incidente ha alimentado el debate entre periodistas y expertos sobre la seguridad y las implicaciones éticas de confiar en la IA para la orientación médica.

ChatGPT Health no es un nuevo modelo de IA, sino una interfaz especializada construida sobre los modelos existentes de OpenAI. Este "wrapper", como se ha descrito, proporciona a la IA instrucciones y herramientas específicas adaptadas a las consultas relacionadas con la salud. También puede acceder al historial médico electrónico de un usuario, lo que podría ofrecer consejos más personalizados.

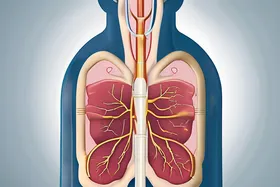

El auge de la búsqueda de síntomas en línea, a menudo denominado "Dr. Google", ha sido una práctica común durante las últimas dos décadas. Sin embargo, el cambio hacia el uso de modelos de lenguaje grandes (LLM, por sus siglas en inglés) como ChatGPT plantea nuevas preguntas sobre la precisión y la responsabilidad. A diferencia de los motores de búsqueda tradicionales que proporcionan enlaces a varias fuentes, los LLM sintetizan información y ofrecen respuestas directas, que pueden ser engañosas o incluso perjudiciales si los datos subyacentes son defectuosos o están sesgados.

Los expertos enfatizan la importancia de comprender las limitaciones de la IA en la atención médica. Si bien la IA puede procesar grandes cantidades de datos e identificar patrones, carece del pensamiento crítico y el juicio matizado de un profesional médico humano. El potencial de diagnóstico erróneo, recomendaciones de tratamiento incorrectas y la difusión de información errónea son preocupaciones importantes.

El estado actual de ChatGPT Health aún se encuentra en sus primeras etapas, y OpenAI aún no ha publicado información detallada sobre su proceso de validación o medidas de seguridad. La empresa se enfrenta al reto de garantizar que la IA proporcione consejos médicos precisos, fiables e imparciales, al tiempo que protege la privacidad del usuario y la seguridad de los datos. Es probable que los desarrollos futuros se centren en perfeccionar los algoritmos de la IA, incorporar los comentarios de los profesionales médicos y establecer directrices claras para su uso en entornos sanitarios.

Discussion

Join the conversation

Be the first to comment